OpenAI lance Point-E, une IA qui génère des modèles 3D

La prochaine percée à prendre d’assaut le monde de l’IA pourrait être les générateurs de modèles 3D. Cette semaine, OpenAI a ouvert Point-E, un système d’apprentissage automatique qui crée un objet 3D à partir d’une invite textuelle. Selon un article publié parallèlement à la base de code, Point-E peut produire des modèles 3D en une à deux minutes sur un seul GPU Nvidia V100.

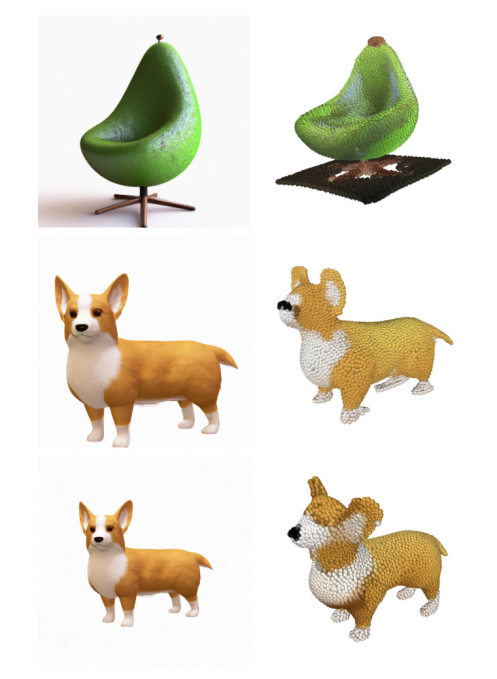

Point-E ne crée pas d’objets 3D au sens traditionnel. Au lieu de cela, il génère des nuages de points ou des ensembles discrets de points de données dans l’espace qui représentent une forme 3D – d’où l’abréviation effrontée. (Le « E » dans Point-E est l’abréviation de « efficacité », car il est apparemment plus rapide que les approches de génération d’objets 3D précédentes.) Les nuages de points sont plus faciles à synthétiser d’un point de vue informatique, mais ils ne capturent pas le grain fin d’un objet. forme ou texture – une limitation clé de Point-E actuellement.

Pour contourner cette limitation, l’équipe de Point-E a formé un système d’IA supplémentaire pour convertir les nuages de points de Point-E en maillages. (Les maillages – les collections de sommets, d’arêtes et de faces qui définissent un objet – sont couramment utilisés dans la modélisation et la conception 3D.) Mais ils notent dans l’article que le modèle peut parfois manquer certaines parties d’objets, ce qui entraîne des formes en blocs ou déformées.

Crédits image : OpenAI

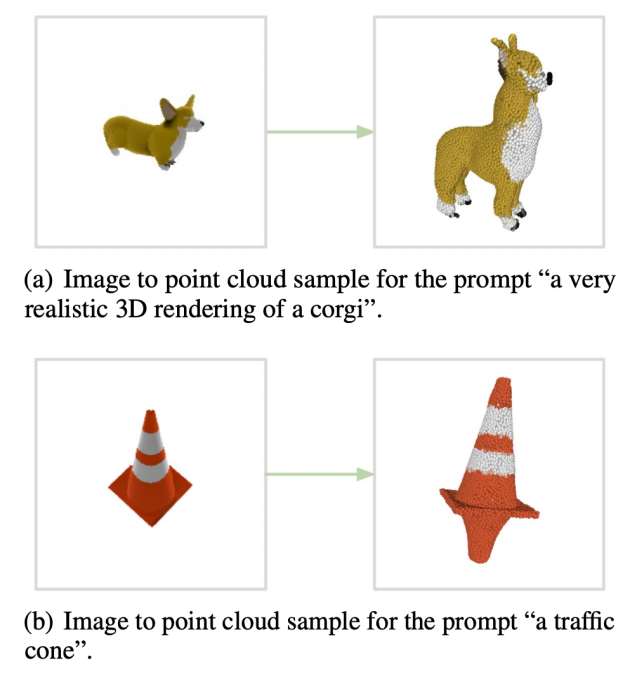

En dehors du modèle de génération de maillage, qui est autonome, Point-E se compose de deux modèles : un modèle texte-image et un modèle image-3D. Le modèle texte-image, similaire aux systèmes d’art génératif comme DALL-E 2 et Stable Diffusion d’OpenAI, a été formé sur des images étiquetées pour comprendre les associations entre les mots et les concepts visuels. Le modèle d’image en 3D, d’autre part, a été alimenté par un ensemble d’images associées à des objets 3D afin qu’il apprenne à se traduire efficacement entre les deux.

Lorsqu’on lui donne une invite de texte – par exemple, « un engrenage imprimable en 3D, un seul engrenage de 3 pouces de diamètre et d’un demi-pouce d’épaisseur » – le modèle texte-image de Point-E génère un objet rendu synthétique qui est envoyé à l’image-à- Modèle 3D, qui génère ensuite un nuage de points.

Après avoir formé les modèles sur un ensemble de données de « plusieurs millions » d’objets 3D et de métadonnées associées, Point-E pourrait produire des nuages de points colorés qui correspondaient fréquemment aux invites de texte, selon les chercheurs d’OpenAI. Ce n’est pas parfait – le modèle image en 3D de Point-E ne parvient parfois pas à comprendre l’image du modèle texte en image, ce qui entraîne une forme qui ne correspond pas à l’invite de texte. Pourtant, c’est des ordres de grandeur plus rapides que l’état de l’art précédent – du moins selon l’équipe OpenAI.

Conversion des nuages de points Point-E en maillages. Crédits image : OpenAI

« Bien que notre méthode donne de moins bons résultats sur cette évaluation que les techniques de pointe, elle produit des échantillons en une petite fraction du temps », ont-ils écrit dans l’article. « Cela pourrait le rendre plus pratique pour certaines applications, ou pourrait permettre la découverte d’objets 3D de meilleure qualité. »

Quelles sont les applications, exactement ? Eh bien, les chercheurs d’OpenAI soulignent que les nuages de points de Point-E pourraient être utilisés pour fabriquer des objets du monde réel, par exemple grâce à l’impression 3D. Avec le modèle de conversion de maillage supplémentaire, le système pourrait – une fois qu’il est un peu plus raffiné – également trouver sa place dans les workflows de développement de jeux et d’animations.

OpenAI est peut-être la dernière entreprise à se lancer dans la mêlée des générateurs d’objets 3D, mais – comme mentionné précédemment – ce n’est certainement pas la première. Plus tôt cette année, Google a publié DreamFusion, une version étendue de Dream Fields, un système 3D génératif que la société a dévoilé en 2021. Contrairement à Dream Fields, DreamFusion ne nécessite aucune formation préalable, ce qui signifie qu’il peut générer des représentations 3D d’objets sans données 3D.

Alors que tous les regards sont tournés vers les générateurs d’art 2D à l’heure actuelle, l’IA de synthèse de modèles pourrait être le prochain grand perturbateur de l’industrie. Les modèles 3D sont largement utilisés dans le cinéma et la télévision, la décoration d’intérieur, l’architecture et divers domaines scientifiques. Les cabinets d’architectes les utilisent pour faire la démonstration de bâtiments et de paysages proposés, par exemple, tandis que les ingénieurs utilisent des modèles pour concevoir de nouveaux appareils, véhicules et structures.

Cas de défaillance du point E. Crédits image : OpenAI

Cependant, les modèles 3D prennent généralement un certain temps à créer, entre plusieurs heures et plusieurs jours. Une IA comme Point-E pourrait changer cela si les problèmes sont résolus un jour, et faire d’OpenAI un profit respectable en le faisant.

La question est de savoir quel type de litiges de propriété intellectuelle pourraient survenir dans le temps. Il existe un vaste marché pour les modèles 3D, avec plusieurs marchés en ligne, dont CGStudio et CreativeMarket, permettant aux artistes de vendre le contenu qu’ils ont créé. Si Point-E fait son chemin et que ses modèles arrivent sur les marchés, les artistes modélistes pourraient protester, soulignant la preuve que l’IA générative moderne emprunte beaucoup à ses données de formation – des modèles 3D existants, dans le cas de Point-E. Comme DALL-E 2, Point-E ne crédite ni ne cite aucun des artistes qui auraient pu influencer ses générations.

Mais OpenAI laisse ce problème pour un autre jour. Ni le document Point-E ni la page GitHub ne font mention du droit d’auteur.

A leur crédit, les chercheurs faire mentionnent qu’ils s’attendent à ce que Point-E souffre de autre des problèmes, comme les biais hérités des données de formation et le manque de garanties autour des modèles qui pourraient être utilisés pour créer des « objets dangereux ». C’est peut-être pourquoi ils prennent soin de caractériser Point-E comme un « point de départ » qui, espèrent-ils, inspirera « d’autres travaux » dans le domaine de la synthèse texte-3D.